Yapay zekanın savaşta kullanılması: Claude/Anthropic, Trump tartışması ve İran savaşı bağlamında 2026 rehber-analiz

Bu rehber kimin için

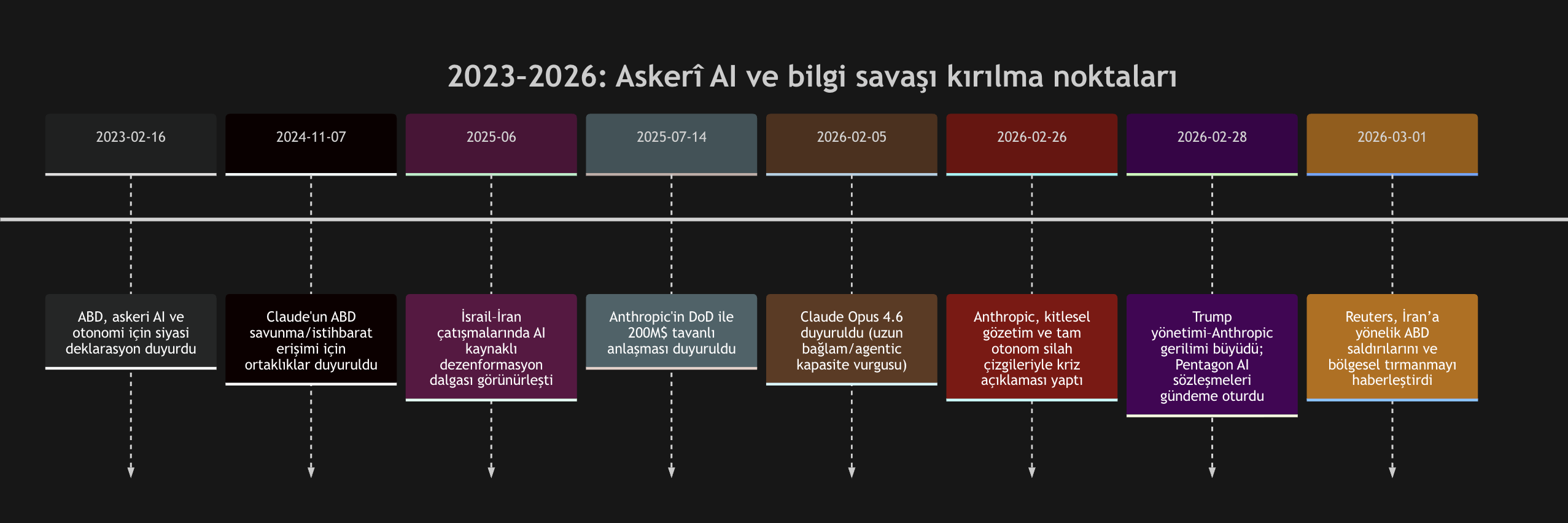

“Yapay zekanın savaşta kullanılması” artık yalnızca savunma sanayii başlığı değil; kurumsal risk yönetimi, bilgi güvenliği ve itibar yönetiminin de bir parçası. 2026 itibarıyla iki şey aynı anda hızlandı: (1) yapay zekânın karar destek, istihbarat analizi, siber, bilgi operasyonları gibi alanlarda pratik kullanımı; (2) aynı teknolojilerin yanlış kullanım (dezenformasyon, aşırı gözetim, otonom öldürücü sistemler) riskleri nedeniyle hukuk ve etik tartışmaların sertleşmesi. (SIPRI; ICRC; Reuters).

Bu yazı, askerî operasyonlara yönelik taktik/operasyonel talimat vermez; hedefleme algoritmaları, silah entegrasyonu veya saldırı yöntemleri anlatılmaz. Odak, kurumların kamuya açık bilgilerle riskleri anlaması, uyum çerçevesi kurması ve Claude benzeri modelleri (varsa) güvenli/etik biçimde kullanabilmesi içindir. (NIST; Anthropic Usage Policy).

Güncel Durum

2026’nın en “somut” kırılma anlarından biri, Anthropic PBC ile U.S. Department of Defense arasında, Claude’un askerî kullanım şartları üzerinden büyüyen anlaşmazlığın siyasallaşması ve bunun Donald J. Trump yönetiminde bir “kara liste / tedarik zinciri riski” tartışmasına dönüşmesidir. (Reuters; Washington Post; Anthropic açıklamaları).

İran ekseninde ise savaşın kendisi kadar “bilgi alanı” belirleyici hale geldi: X üzerinde “milyonlara ulaşan” yanlış/çarpıtılmış içerikler, yapay zekâ ile üretilmiş veya manipüle edilmiş görseller ve yanlış bağlamlandırılmış videoların kriz anlarında hızla yayıldığına dair güncel incelemeler var. (WIRED; CETaS/Turing; OECD AI incidents).

Bu tablo kurumlar için net bir mesaj verir: Yapay zekâ savaşta “tek bir şey” değil; istihbarat ve planlama, dezenformasyon ve algı, siber savunma/saldırı, lojistik ve bakım, komuta-kontrol karar desteği gibi birbirinden farklı katmanların ortak adı. Bu yüzden kurumsal karşılık da “tek bir güvenlik ayarı” olamaz; yönetişim, erişim, denetim kaydı, veri minimizasyonu ve test/QA gibi katmanlı bir kontrol seti gerekir. (SIPRI; NIST; NCSC).

Yapay zekanın savaşta kullanılması bugün hangi işlerde görülüyor

Savaş alanına yakın karar destek

Saha yakınında yapay zekâ kullanımını tek bir “otonom silah” başlığına indirgemek, 2026 gerçekliğini kaçırır. Stockholm International Peace Research Institute, askerî alanda yapay zekânın fırsat alanlarını ISR (istihbarat-gözetleme-keşif), bakım/lojistik, komuta-kontrol (hedefleme dahil), bilgi ve elektronik harp, otonom sistemler gibi geniş bir yelpazede ele alır. (SIPRI).

Bu “karar destek” katmanının kritik özelliği şudur: Yapay zekâ çoğu senaryoda “ateş eden” değil; veri yığınını hızla işleyip insanın kararını etkileyen sistemdir. Bu, verimliliği artırabilir; ama hatanın bedeli de büyür. Reuters’ın savunma teknolojisi analizleri, asıl devrimin çoğu zaman “hedefleme düğmesine basan robot” değil, çok daha geniş karar setlerinde veriyi işleyip hız kazandıran sistemler olduğunu vurgular. (Reuters analiz).

Somut örnek: Ukraine dijital dönüşüm ve savunma yetkilileri, AI’nin hedef arama/tespit döngüsünde saatler sürebilecek görüntü taramasını ciddi biçimde hızlandırabildiğini; ayrıca bazı drone sistemlerinde otonomi seviyesinin arttığını kamuya açık şekilde anlatıyor. (Reuters).

Bilgi alanı, siber ve etki operasyonları

Savaşın “bilgi alanı” katmanında üretken yapay zekâ; içerik üretim maliyetini düşürerek propaganda/dezenformasyonu ölçekleyebilir, sahte görsel/işitsel materyallerle belirsizliği büyütebilir ve platformların “hız” avantajıyla doğrulamayı geride bırakabilir. Bu risk, National Institute of Standards and Technology AI Risk Management Framework çerçevesinde “sahte içerik üretimi, kimliğe bürünme, propaganda” gibi başlıklarda açıkça yer alır. (NIST).

Etki/algı operasyonları boyutunda da, RAND Corporation raporları generatif AI’nin analiz, planlama ve etki faaliyetlerinin değerlendirilmesinde bir “araç” olarak rol oynayabileceğini; fakat tek başına çözüm olmadığını vurgular. (RAND).

Siber alanda ise hem saldırı hem savunma kapasitesi büyüyor: prompt injection gibi saldırı sınıfları, kurum içi otomasyon ve model entegrasyonları arttıkça daha kritik hale geliyor. Bu, “AI’yi iş akışına bağladığınızda” riskin salt chat arayüzü seviyesini aşıp operasyonel sisteme taşınması demek. (WIRED; NCSC; CISA/NIST ekosistemi).

Claude ve Anthropic askeri kullanımda nerede duruyor

Resmi dosyalar: hükümet kullanımı ve kırmızı çizgiler

“Claude/Anthropic askerî kullanımda var mı?” sorusunun 2026’daki yanıtı, kamuya açık resmi metinlerde artık daha net: Anthropic CEO’su Dario Amodei, 26 Şubat 2026 tarihli açıklamasında Claude’un ABD ulusal güvenlik kurumlarında (kendi ifadesiyle “Department of War” ve istihbarat topluluğu) istihbarat analizi, modelleme-simülasyon, operasyonel planlama, siber operasyonlar gibi “mission-critical” uygulamalarda yaygın kullanıldığını söylüyor. (Anthropic).

Aynı metin, Anthropic’in iki “kırmızı çizgi” üzerinden tartıştığını da açık ediyor: Amerikalıların kitlesel iç gözetimi ve tam otonom (insanı tamamen devre dışı bırakan) öldürücü sistemlerde kullanım. (Anthropic; Reuters).

Bu çerçeve, Anthropic’in yazılı politikasıyla da uyumlu: Anthropic “Usage Policy / AUP” metni; silah tasarımı veya silahlandırma süreçlerine destek verilmemesini, ayrıca belirli gözetim ve “battlefield management applications” gibi alanlarda kişiyi izleme/konum takibi benzeri kullanım risklerini “yasak/uygunsuz” sınıfında ele alıyor. (Anthropic Usage Policy).

Anthropic-Kamu tarafında bir diğer somut köprü de “hükümet altyapısı”dır: Claude’un devlet kurumlarına güvenli altyapılarla sunulması, FedRAMP High gibi çerçevelere referansla ve bulut ortakları üzerinden duyurulmuştur. (Anthropic).

Kamuya açık Claude ile askeri-grade sistemler arasındaki teknik fark

Kamuya açık bir LLM (Claude gibi) ile “askerî-grade” sistemler arasındaki farkı netleştirmek gerekir; aksi halde kurumlar yanlış risk değerlendirmesi yapar.

Birincisi ağ ve veri sınıflandırması: Kamu sürümleri internet tabanlıdır; askerî kullanımda ise “sınıflandırılmış ağlarda, erişim kontrollü, denetimli” kurulumdan bahsedilir. Anthropic, Claude’un bazı ulusal güvenlik müşterilerinde sınıflandırılmış ağlara kurulduğunu ve “secure infrastructure” ortaklıklarından söz ediyor. (Anthropic; Palantir duyurusu).

İkincisi amaç ve entegrasyon düzeyi: Claude gibi modeller “doğal dil işleme” ağırlıklı bir genel amaçlı katmandır; askeri-grade sistemler ise sensör/veri hattı, zaman kritik karar döngüsü, sertifikasyon, test/validasyon, fail-safe mekanizmaları, insan kontrolü gibi katmanlarla “ürünleştirilmiş” yapılardır. Bu yüzden Claude’un “doğrudan silahı kontrol etmesi” iddiası, çoğu zaman kamuya açık kanıtlardan ziyade spekülasyon alanına girer; resmi metinler daha çok analiz/planlama/siber gibi görevleri işaret eder. (Anthropic açıklaması; SIPRI; ICRC).

Üçüncüsü güvenlik politikası ve sözleşme dili: Anthropic’in Usage Policy metni, silah tasarımı ve belirli gözetim kullanım örneklerini açıkça kısıtlar. Ayrıca politika, “gerekirse belirli devlet müşterileri için sözleşmeyle özel kısıtlar” uygulayabileceğini de söylüyor. Bu, kamu-sivil ürün ile devlet/misyon ortamı arasındaki hukuki “çitin” tasarlanabildiği anlamına gelir. (Anthropic Usage Policy).

Dördüncüsü doğruluk ve güvenilirlik standardı: Frontier modeller çok güçlü olsa da “yanlış ama ikna edici” çıktı üretme riski (hallucination) kurumsal güvenlik literatüründe sistematik bir risk olarak ele alınır. Bu durum, yüksek riskli alanlarda insan denetimi ve test/validasyon ihtiyacını artırır. (NIST; UK değerlendirme ekosistemi).

Trump tartışması: devlet sözleşmeleri, guardrails ve yönetişim

Şubat 2026 olay zinciri

2026 Şubat’ında “yapay zekânın savaşta kullanılması” tartışması, yalnızca teknoloji değil, açık biçimde siyasi bir kriz başlığına dönüştü. Reuters ve diğer büyük yayınlar; Pentagon ile Anthropic arasında “AI kullanımının tüm yasal amaçlara açılması” talebi üzerinden gerilimin tırmandığını; Anthropic’in iki istisnayı (kitlesel iç gözetim ve tam otonom öldürücü sistemler) kabul etmediğini yazdı. (Reuters; Anthropic).

Ardından, Trump’ın federal kurumlara Anthropic’le çalışmayı durdurma yönünde talimat verdiği ve Anthropic’in “supply chain risk” olarak etiketlenmesi tartışmasının büyüdüğü bildirildi. (Reuters; CBS).

Bu dönemde OpenAI tarafının da Pentagon’la anlaşma detaylarını kamuoyuna açıkladığı; “kırmızı çizgiler” olarak kitlesel gözetim ve otonom silah yönlendirme gibi alanlarda sınırlamalar vurguladığı görüldü. (Reuters; OpenAI duyurusu).

Not: Haber akışındaki bu “kırmızı çizgi / sözleşme / siyasi söylem” üçgeni, kurumlar için şu sinyali verir: Üretken yapay zekâ artık sadece BT konusu değil; doğrudan kamu sözleşmesi, uyum, etik ve itibar konusu. (Washington Post; Reuters).

Bu tartışmanın kurumlar için anlamı

Kurumsal açıdan bu kriz, üç “business boss” dersine indirgenebilir:

Bir: Vendor risk gerçek bir maliyet kalemidir. Bir model tedarikçisinin “kullanım şartları” veya politik tutumu yüzünden kamu/kurumsal erişimin kesilmesi, operasyonel sürekliliği bozar. “Hangi model daha iyi?” sorusu kadar “hangi model hangi koşullarda erişilebilir kalır?” sorusu da kritiktir. (Reuters; Anthropic açıklamaları).

İki: Sözleşme dili, teknik güvenlik kadar önemlidir. Anthropic’in kırmızı çizgileri “bağlayıcı sözleşme şartı” olarak görmek istemesiyle, bazı aktörlerin bunu “iç kontrol/teknik önlem” olarak çerçevelemesi arasında ciddi fark var. Bu fark, kimlerin hangi koşullarda “hesap verebilir” olduğuna dair risk doğurur. (Anthropic; OpenAI metni; yorum analizleri).

Üç: Uygulama kapsamını netleştirmeyen kurum, en pahalı riski satın alır. “Claude’u savunmada kullanıyoruz” ifadesi; istihbarat dokümanı özetlemeden, otonom sistem karar döngüsüne kadar uzanabilecek bir spektrumdur. Eğer kapsam ve denetim net değilse, risk bütçesi de net değildir. (SIPRI; ICRC; NIST).

Burada özel sektör için en rasyonel yaklaşım şudur: Savaş/çatışma bağlamında AI konusunu “jeopolitik risk” olarak düşün; iletişim süreçlerini, dezenformasyon tehdidini ve veri güvenliğini aynı çatı altında yönet. Bunu kurumsal ölçekte yapmak için Yapay Zeka ve Marka Danışmanlığı disiplinlerinin birlikte çalışması gerekir (linkleme için kelimeler özellikle bold). (NIST; CETaS/Turing).

İran savaşı bağlamında yapay zeka: sahada ve bilgi savaşında kullanım

Dezenformasyon ve deepfake: maliyeti düşük, etkisi yüksek

İran eksenli çatışma gündeminde, “bilgi kirliliği” artık tali değil, ana harekât unsuru gibi çalışıyor. 2026 Şubat sonunda, WIRED; ABD ve İsrail’in İran’a yönelik operasyon duyurusunu izleyen saatlerde X’in yanlış/çarpıtılmış içerikle “taştığını”, yüzlerce viral paylaşımın milyonlarca görüntülenmeye ulaştığını; bunların içinde AI ile üretilmiş/alter edilmiş görseller, yanlış konumlandırılmış videolar ve hatta oyun görüntülerinin “gerçek çatışma” diye sunulması gibi örnekler olduğunu yazdı. (WIRED).

Bu durum sadece “platform problemi” değil; kurumlar için kriz anında yanlış karar alma ve itibar/finans etkisi problemidir. Çünkü dezenformasyon, piyasa davranışını, seyahat/turizm kararlarını, tedarik zinciri planlamasını ve güvenlik algısını doğrudan etkileyebilir. (NIST; Reuters/ITU raporu).

Özellikle İran-İsrail çatışmalarında AI kaynaklı dezenformasyonun yoğunlaştığı 2025 örnekleri, bu trendi geriye dönük doğruluyor. CETaS/Turing raporu, 2025 İsrail-İran krizinde AI üretimi dezenformasyon örnekleri bulunduğunu ve kriz dönemlerinde bu tür içeriklerin hızlı yayılım riskini vurgular. (CETaS/Turing).

OECD’nin AI incident kayıtları da, İsrail-İran çatışması sırasında yayılan AI üretimi deepfake videoların doğrulama mekanizmalarını zorladığına dair örnek olay kayıtları içeriyor. (OECD AI Incidents).

Drone/ISR ve otonomi: jamming, hız ve güvenlik

Saha tarafında “generatif AI = savaş” denklemi doğru değil; fakat AI destekli sistemlerin drone/ISR ekseninde kullanımı hızlı genişliyor. Reuters, Ukrayna örneğinde hedefe kilitlenip bağlantı kaybı sonrası dahi uçuşu sürdürebilen otonomi türlerini; ayrıca görüntü analizinin insan saatlerini ciddi ölçüde azalttığına dair beyanları haberleştirdi. (Reuters).

Yine Reuters, Auterion gibi firmaların “AI drone guidance kit” teslimatları üzerinden, hedefin son safhada görsel takibi gibi kabiliyetlerin jamming baskısı altında “operasyonel ihtiyaç” haline geldiğini yazdı. Bu tür haberler, AI’nin sahada çoğu zaman “otonomi arttırma” ve “iletişim kesintisine dayanıklılık” için kullanıldığını gösterir. (Reuters).

İran bağlamında güncel sıcak çatışma tarafında Reuters, ABD’nin İran hedeflerine yönelik operasyonlarını (Mart 2026) ve kullanılan sistemleri haberleştirdi. Bu doğrudan “Claude kullanıldı” kanıtı değildir; fakat şunu gösterir: operasyonel tempo arttıkça “hızlı analiz ve koordinasyon” ihtiyacı büyür ve AI karar destek sistemleri için talep artışı oluşur. (Reuters).

Aynı dönemde, bilgi alanının sahayı gölgelediği bir gerçek: İster gerçek ister sahte olsun, çatışma görüntülerinin hızla yayılması “gerçek zamanlı doğrulama kapasitesi”ni bir savaş kabiliyeti gibi kritik hale getiriyor. (WIRED; Reuters/ITU; CETaS/Turing).

Aşağıdaki iki şema, bu çok katmanlı tabloyu “yönetilebilir” hale getirir.

Riskler ve hukuki/etik çerçeve: insan kontrolü şartı

Etik ve hukuk: IHL, sorumluluk, meaningful human control

Askerî AI tartışmalarında “kırmızı çizgi” kavramı, büyük ölçüde iki değere dayanır: hesap verebilirlik ve insan kontrolü. International Committee of the Red Cross, otonom silah sistemlerinde “meaningful human control” ihtiyacını ve kontrol kaybının hukuki/etik sonuçlarını uzun süredir vurgular. (ICRC).

Normatif düzlemde U.S. Department of State yayımlı “Responsible Military Use of AI and Autonomy” deklarasyonu, askeri AI kullanımının uluslararası hukuka uyum ve risk azaltımı ilkeleriyle ele alınmasını hedefler. Bu metinler bağlayıcı olmayabilir; ancak kurumlar için “beklenen davranış standardı” yaratır. (state.gov).

Kurumsal düzeyde pratik çıkarım: Eğer bir kurum (kamu ya da özel sektör) kriz/çatışma dönemlerinde AI tabanlı karar desteği kullanıyorsa, “insan onayı nerede başlar/nerede biter?” sorusunu prosedüre dökmeden “uyum” iddiası zayıf kalır. (ICRC; SIPRI).

Burada Claude özelinde önemli not: Anthropic Usage Policy; silah geliştirme/tasarımı gibi alanlarda açık “yasak” koyarken, aynı zamanda bazı devlet müşterileriyle “misyon ve yetkilerine göre özel sözleşmesel kısıtlar” tasarlanabileceğini söylüyor. Bu, “etik sınır” ile “operasyonel ihtiyaç” arasında sözleşmeye dayalı bir yönetişim odağı olduğuna işaret eder. (Anthropic Usage Policy; Anthropic açıklaması).

Operasyon ve güvenlik: hallucination, prompt injection, veri sızıntısı, denetim

Operasyonel riskleri “tek bir başlık” gibi görmek kurumları yanıltır. Yapay zekânın savaş/kriz bağlamındaki başlıca risk yüzeyleri şunlardır:

- Yanlış ama ikna edici çıktı (hallucination) ve eksik bilgi riski: NIST çerçeveleri, generatif modellerin yanlış/aldatıcı içerik üretebilme riskini ve bunun güvenilirlik/validasyon ihtiyacını vurgular. (NIST).

- Prompt injection / dolaylı talimat saldırıları: Model iş akışa bağlandığında, saldırganlar “girdiye gömülü talimatlarla” modeli yanlış davranışa itebilir. Bu riskin “tam çözümü yok” yaklaşımı, güvenlik tasarımında ayrıcalık minimizasyonu ve denetimi zorunlu kılar. (WIRED; NCSC).

- Veri sızıntısı ve gözetim kayması: Özellikle kriz dönemlerinde “daha fazla veri toplayalım” refleksi doğar. Ancak kitlesel gözetim hem hukuki hem itibar riskini büyütür; 2026’daki Anthropic–Pentagon tartışmasının merkezinde de bu var. (Anthropic açıklamaları; Reuters).

- Tedarik zinciri ve model güvenliği (distillation / guardrail kaybı): Anthropic, distillation (modelin yasa dışı kopyalanması/çıkarımı) gibi süreçlerin güvenlik korumalarını yok edip ulusal güvenlik riskini büyütebileceğini anlatıyor. (Anthropic research).

- Dezenformasyonun hız ve ölçek avantajı: İran-İsrail bağlamında deepfake ve yanlış görüntülerin hızla yayıldığı, doğrulama kapasitesinin kritik hale geldiği çok sayıda yayın var. (WIRED; CETaS/Turing; Reuters/ITU).

Aşağıdaki kontrol listesi, Claude benzeri modellerin kurum içinde “güvenli/etik” kullanımına yönelik, savaş/kriz hassasiyetini gözeten minimum standardı hedefler. (Sadece savunma amaçlıdır; operasyonel taktik içermez.)

Kontrol listesi: Kurumlar Claude benzeri modelleri güvenli/etik kullanmak için ne yapmalı?

- Erişim kontrolü

- Rol bazlı yetki (RBAC), en az ayrıcalık ilkesi

- Hassas görevlerde çift onay (two-person rule) ve “insan onayı” kapısı

- Denetim izi ve izleme

- Prompt/çıktı/ağ çağrısı/ağır işlem kayıtlarının audit log’a yazılması

- Modelin hangi veriye eriştiğinin “kanıtlanabilir” olması (traceability)

- Veri minimizasyonu ve bölümlendirme

- “Gerekli değilse alma” yaklaşımı (conflict/kriz döneminde özellikle)

- Proje/veri alanlarını compartmentalization ile ayırma

- Model seçimi ve parametre disiplini

- Kritik kararlarda deterministikliğe yaklaş: düşük sıcaklık / kontrollü çıktılar

- Göreve göre model seçimi: “en güçlü model” otomatik doğru değildir (risk ve maliyet artar)

- İç dokümantasyon standardı

- “CLAUDE.md benzeri” kullanım sınırları, veri kaynakları, onay akışı ve yasaklı kullanım tanımları

- Hangi use-case’in kesinlikle yasak olduğu (silah tasarımı, kitlesel gözetim vb.) açık yazılı olsun

- Test/QA ve kırmızı ekip

- Prompt injection senaryoları ve yanlış bilgi stres testleri

- Kriz anı “yük testi”: doğrulama ve kontrol kapıları çalışıyor mu?

- İletişim ve dezenformasyon dayanıklılığı

- Krizde “tek doğruluk kaynağı” (single source of truth) ve hızlı düzeltme protokolü

- Sahte içerik tespiti için süreç (doğrulama, ikinci kaynak, açıklama yayımlama)

(NIST AI RMF; Anthropic Usage Policy; NCSC güvenli AI geliştirme; WIRED prompt injection analizleri).

Kurumlar için pratik önlemler: karşılaştırma, yerel senaryo, SEO varyasyonları ve SSS

Karşılaştırma ve yerel senaryo

Karşılaştırma: LLM (Claude) ile askerî-grade AI aynı şey mi?

Aşağıdaki karşılaştırma, kurumların “yanlış beklenti” yüzünden risk büyütmesini engellemek için yüksek seviyede tutulmuştur:

- Kamuya açık LLM (Claude gibi)

- Güçlü yan: metin-odaklı analiz (özet, çeviri, raporlama), bilgi işleme, dokümantasyon, karar destek “hazırlığı”

- Risk: hallucination, prompt injection, veri sızıntısı; yanlış kullanımda dezenformasyon üretim kapasitesi

- Yönetim ihtiyacı: erişim kontrolü + audit + veri minimizasyonu + insan onayı (Anthropic Usage Policy; NIST).

- Güvenli devlet/kurumsal kurulum (sınıflandırılmış ağ / özel sözleşme)

- Güçlü yan: veri egemenliği, denetim, misyon ihtiyaçlarına göre sözleşme/guardrail

- Risk: tedarik zinciri ve politika değişimlerinin operasyonel sürekliliğe etkisi; sözleşme savaşları (2026 örneği)

- Yönetim ihtiyacı: vendor risk planı + çıkış stratejisi + uyum dokümantasyonu (Anthropic açıklaması; Reuters).

- Askerî-grade entegre sistem (sensör + karar döngüsü + sertifikasyon)

- Güçlü yan: zaman kritik ortamlarda “uçtan uca” sistem mühendisliği

- Risk: hata bedeli çok yüksek; insan kontrolü ve sorumluluk zinciri baskısı

- Yönetim ihtiyacı: IHL uyumu, test/validasyon, meaningful human control (ICRC; SIPRI).

Yerel senaryo: Ege’de turizm/şehir ekonomisine etkisi nasıl yönetilir?

Kuşadası–Aydın–İzmir hattında turizm gelirleri, “algı” ve “güven”e çok duyarlıdır. İran ve çevresindeki çatışma dönemlerinde, sosyal medyada hızla yayılan sahte içerikler; rezervasyon iptallerini, seyahat kararlarını, hatta çalışan güvenliği algısını bile etkileyebilir. Bu, “askerî” bir problem olmaktan çıkıp, doğrudan “iş sürekliliği ve gelir koruma” problemine dönüşür. (CETaS/Turing; WIRED).

Bu senaryoda kurumsal karşılık: “kriz izleme + doğrulama + tek ses” mekanizmasıdır. Örneğin markanın kriz iletişimini, içerik doğrulamasını ve platform yanıtlarını otomatikleştiren bir AI Agent kurgusu; hukuk/uyum onayıyla, kurumun yanlış bilgiye “ölçülü ve hızlı” cevap verebilmesini sağlar. Aynı anda, Marka Danışmanlığı kurgusu (krizde mesaj mimarisi, kanıt standardı, paydaş iletişimi) finansal kaybı azaltan bir sigorta gibi çalışır. (NIST; CISA seçim/dezenformasyon risk çerçeveleri).

Şu an kullanıcıların en çok merak ettiği konular:

- “yapay zekâ savaşta nasıl kullanılıyor 2026”

- “askerî yapay zekâ karar destek riskleri”

- “dezenformasyon ve deepfake savaş örnekleri”

- “Claude askeri kullanım var mı”

- “Anthropic Pentagon tartışması nedir”

- “İran savaşı AI dezenformasyon X platformu”

- “otonom silah vs karar destek sistemi farkı”

- “meaningful human control nedir”

- “askerî AI için etik ve hukuk rehberi”

- “kurumlar kriz döneminde AI risk yönetimi”

SSS

- “Yapay zekanın savaşta kullanılması” sadece otonom silah mı demek?

Hayır. SIPRI ve Reuters analizleri, kullanımın ISR’den lojistiğe, komuta-kontrolden bilgi harbine kadar geniş bir spektrum olduğunu vurgular. Otonom öldürücü sistemler tartışmanın en “yüksek riskli” ucudur; ama karar destek ve bilgi alanı çoğu zaman daha yaygın ve kısa vadede daha etkili olabilir. (SIPRI; Reuters). - Claude/Anthropic askerî alanda kullanılıyor mu?

Anthropic’in 26 Şubat 2026 açıklaması, Claude’un ABD ulusal güvenlik kurumlarında istihbarat analizi, operasyonel planlama ve siber operasyonlar gibi alanlarda “extensively deployed” olduğunu söylüyor. Bu, kamuya açık resmi bir beyan olarak güçlü bir kanıttır. (Anthropic). - Claude’un askerî kullanımı “silahı kontrol etmek” anlamına mı geliyor?

Kamuya açık metinler daha çok analiz/planlama/siber gibi görevleri işaret ederken, Anthropic Usage Policy silah geliştirme/tasarımı gibi alanlara destek verilmesini yasaklar. Bu yüzden “doğrudan silah kontrolü” gibi iddialar, açık kanıt olmadan genelleştirilemez; ayrıca halkın kullandığı Claude ile sınıflandırılmış ağ kurulumları teknik olarak aynı ortam değildir. (Anthropic Usage Policy; Anthropic açıklaması). - İran çatışmaları neden “AI + dezenformasyon” açısından kritik bir örnek haline geldi?

2025–2026’da İran-İsrail hattında AI ile üretilmiş/alter edilmiş içerikler, yanlış bağlamlandırılmış videolar ve platformlarda hızlı yayılım öne çıktı. WIRED, 2026’daki İran operasyonları sonrasında X’in yanlış bilgiyle “taştığını” örneklerle anlatıyor; CETaS/Turing ve OECD gibi kaynaklar da AI kaynaklı dezenformasyonun kriz anlarında arttığını kaydediyor. (WIRED; CETaS/Turing; OECD). - Bir kurum (kamu/özel) kriz döneminde Claude benzeri modelleri kullanacaksa en kritik üç savunma nedir?

Erişim kontrolü (RBAC + insan onayı), audit logging (izlenebilirlik) ve veri minimizasyonu (gereksiz veriyi hiç sokmamak). Buna “prompt injection stres testi” ve kriz iletişim protokolü eklendiğinde, risk ciddi ölçüde düşer. (NIST; NCSC; WIRED prompt injection).

5 maddelik hızlı eylem planı

- Kurum içinde “AI kullanım kapsamı”nı yazılılaştır: hangi kullanım serbest, hangisi kesin yasak?

- Kriz anı için “dezenformasyon doğrulama” playbook’u kur: tek doğruluk kaynağı, hızlı düzeltme, kanıt standardı.

- Model erişimini katmanla: düşük riskli görevlerde geniş erişim; yüksek riskli görevlerde çift onay ve kayıt zorunluluğu.

- Prompt injection ve yanlış bilgi testlerini düzenli yap: özellikle dış kaynaktan veri çeken iş akışlarında.

- Vendor risk/çıkış stratejisi hazırla: siyasi/ihale/sözleşme krizlerinde iş sürekliliği bozulmasın.

Kurumunuzun kriz dönemlerinde yanlış bilgiye dayanarak maliyet üretmesini istemiyorsanız; “dezenformasyon izleme + doğrulama + uyum” hattını bir arada tasarlayan, ölçülebilir bir yapı kurmanız gerekir. Bunu, iş hedeflerinize uygun bir Yapay Zeka ve AI Agent kurgusuyla (erişim kontrolü, audit, veri minimizasyonu, QA) ve kriz mesaj mimarisini kuran Marka Danışmanlığı yaklaşımıyla birlikte tasarlamak için: ynsocial ile iletişime geç / teklif al.